Il crawling nella SEO consente di esplorare un sito web per individuare eventuali ostacoli tecnici che ne limitano le prestazioni organiche. Ma la vera sfida per gli esperti di marketing e SEO non è l’audit, quanto la definizione delle priorità, ovvero trasformare migliaia di punti dati in azioni misurabili.

In questo articolo, esamineremo i migliori strumenti di crawling SEO sul mercato, evidenziandone punti di forza e limiti, per aiutarvi a investire in una soluzione che trasformi i vostri audit tecnici in risultati misurabili.

Richiedi una demo di CrawlR, lo strumento di Eskimoz che rivoluzionerà le tue scansioni.

Confronto dei migliori strumenti di crawling SEO del 2025

Tra problemi tecnici, migrazioni rischiose e il monitoraggio delle performance dei Core Web Vitals, i professionisti della SEO spesso non dispongono di informazioni chiare e fruibili. Gli strumenti di crawling si sono evoluti proprio per trasformare audit complessi in indicatori orientati ad avere un impatto aziendale.

Alcuni privilegiano l’analisi approfondita, altri la semplicità o la potenza della correlazione dei dati. Ecco una panoramica delle soluzioni più utilizzate nel 2025, insieme ai loro punti di forza, ai limiti e agli utenti più adatti.

1. Crawlr: dal crawling tecnico al processo decisionale SEO

Sviluppato dal team di Eskimoz, CrawlR è stato progettato per convertire dati tecnici in decisioni misurabili e di impatto .

Lo strumento non si limita a scansionare un sito web; rileva, categorizza e assegna priorità a ogni problema in base alla sua gravità, all’impatto SEO e, ora, all’importanza relativa per il settore. Ad esempio, un sito di e-commerce avrà delle metriche di Web Performance (tempi di caricamento, Core Web Vitals ecc.) più ponderate rispetto ai meta tag mancanti – un’impostazione che il cliente può modificare in base alle proprie priorità.

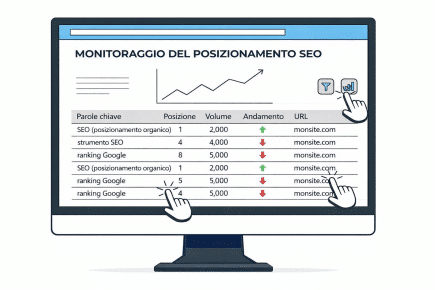

Ogni scansione genera un punteggio complessivo sullo stato di salute del sito, fornendo una visione chiara e prioritaria delle criticità tecniche.

Le anomalie vengono quindi visualizzate per categoria (indicizzazione, contenuto, prestazioni, link interni, ecc.) e accompagnate da raccomandazioni prioritarie.

CrawlR consente inoltre la configurazione completa delle scansioni, inclusa la scansione di JavaScript, per riflettere accuratamente l’esperienza reale di robot e utenti.

In sintesi, CrawlR è uno strumento di auditing intelligente, capace di adattare la propria lettura alle realtà di ogni mercato e di aiutare i decisori a focalizzare le proprie risorse su leve con ROI elevati.

Sono due gli elementi che differenziano CrawlR sul mercato:

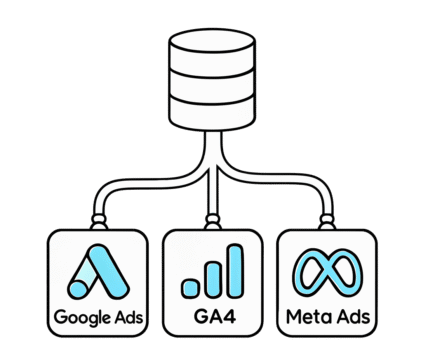

- La sua integrazione nativa nella suite Eskimoz App, che collega crawl, contenuti, dati e tracciamento della posizione.

- Il suo prezzo unificato (a partire da 400 €/mese) dà accesso alla suite completa: Monitoring (avviso di parole chiave), Scribe (scrittura SEO), LLM Ranking (visibilità AI), Brand Protector (protezione del marchio) e Notorious (gestione della link building).

👉 In sintesi: CrawlR non si limita a scansionare un sito, ma assegna, pondera e contestualizza le priorità tecniche per massimizzare l’impatto della strategia SEO.

Richiedi una demo gratuita di CrawlR

2. Screaming Frog: il punto di riferimento per i freelancer

Screaming Frog rimane lo strumento preferito dai freelance e dai piccoli team di esperti SEO per verificare rapidamente un sito web o convalidare una migrazione.

Il suo principale vantaggio: una scansione rapida e precisa che rileva i principali errori tecnici (link interrotti, tag mancanti, duplicati) in pochi minuti.

Tuttavia, la sua interfaccia di base e la mancanza di una priorità automatica lo rendono più uno strumento di analisi che di gestione.

👉 In sintesi: uno strumento di auditing veloce, affidabile e preciso, che però richiede un’interpretazione approfondita per estrarne valore strategico.

3. OnCrawl: il potere del Data Driven per siti di grandi dimensioni

OnCrawl è progettato per siti web con un elevato numero di pagine che necessitano di collegare dati di scansione, log e analisi .

Il suo punto di forza risiede nell’analisi basata sui dati, che evidenzia la correlazione tra struttura tecnica e prestazioni SEO.

Tuttavia, la sua complessità funzionale e i costi elevati ne limitano l’utilizzo a team tecnici o di analisi dati fortemente qualificati.

Meno accessibile ai team di marketing, richiede competenze significative per trasformare le intuizioni in azioni concrete.

👉 In sintesi: uno strumento potente ma più complesso da utilizzare rispetto a CrawlR , che automatizza già la definizione delle priorità e l’analisi aziendale.

4. Botify: l’opzione ideale per team numerosi

Botify risponde alle esigenze delle grandi aziende che necessitano di monitorare le prestazioni SEO su larga scala .

Lo strumento combina crawling, analisi dei log e intelligenza artificiale per modellare l’impatto delle ottimizzazioni sui KPI aziendali.

Il suo punto di forza risiede nell’eccezionale profondità di analisi, ideale per siti web internazionali.

Tuttavia, la sua complessità e il costo elevato ne fanno una soluzione riservata alle organizzazioni con un solido supporto tecnico.

👉 In sintesi: uno strumento completo per grandi aziende, ma la sua interfaccia complessa lo rende più adatto a team tecnici che ad esperti di marketing e SEO.

5. Sitebulb: un crawler visivo ed educativo

Sitebulb colpisce per la sua interfaccia chiara e i report visivi facili da interpretare, perfetti per i team SEO o di marketing che desiderano comprendere la struttura del proprio sito senza dover ricorrere a complessi fogli di calcolo.

Lo strumento evidenzia errori di scansione, contenuti duplicati e problemi di link interni, rendendo al contempo i dati tecnici più accessibili.

Tuttavia, rimane limitato per l’analisi aziendale per l’assenza di priorità automatiche o correlazione diretta con i KPI SEO .

Utile per l’audit, meno per guidare una strategia di performance.

👉 In sintesi: uno strumento chiaro e didattico per visualizzare lo stato di un sito, ma meno orientato alle decisioni e all’impatto rispetto a una soluzione come CrawlR .

6. DeepCrawl: il crawling su larga scala

DeepCrawl si rivolge a team e agenzie SEO avanzate che necessitano di pianificare audit su scala industriale. Lo strumento offre un crawling automatizzato nel cloud e il monitoraggio collaborativo delle modifiche tecniche, utili per la gestione simultanea di più siti.

Tuttavia, la sua gestione complessa e il prezzo elevato ne limitano l’adozione al di fuori di aziende di grandi dimensioni.

👉 In sintesi: un solido strumento per il monitoraggio, ma meno orientato all’azione rispetto a CrawlR , che semplifica la lettura e la definizione delle priorità delle ottimizzazioni.

Tabella comparativa dei migliori crawler SEO del 2025

| Attrezzo | Tipo | Prezzo | Punti di forza | Confini | Ideale per |

| CrawlR (Eschimoz) | Cloud | A partire da € 400/mese (suite Eskimoz App inclusa) | Raccomandazioni prioritarie, visualizzazione chiara dei dati, integrazione delle app SEO/Contenuti/Dati | Nessuna analisi del registro del server | Agenzie, responsabili marketing, responsabili SEO |

| Screaming Frog | Desktop | €259/anno | Velocità, accuratezza degli audit, elaborazione locale | Interfaccia grezza, nessuna priorità | Liberi professionisti, piccoli team SEO |

| OnCrawl | Cloud | Prezzo su richiesta | Correlazione dati/registri, reporting avanzato | Complesso da usare, costo elevato | Grandi siti web. Team Data Driven. |

| Botify | Cloud | Prezzo su richiesta (licenza Enterprise) | Intelligenza artificiale predittiva, reporting completo, monitoraggio dei ROI SEO | Molto costoso, supporto necessario | Grandi gruppi, strutture internazionali |

| Sitebulb | Desktop | € 13/mese | Visualizzazione chiara, report didattici | Scarsa priorità, nessuna analisi avanzata | TPE, consulenti SEO |

| DeepCrawl | Cloud | Circa 140 €/mese | Scansione pianificata, collaborazione multi-profilo | Agenzie, grandi aziende |

Entro il 2025, la scelta di uno strumento di crawling SEO dipenderà non tanto dalla potenza di calcolo quanto dalla capacità di trasformare i dati in decisioni misurabili.

Le soluzioni legacy (Screaming Frog, OnCrawl) rimarranno rilevanti per casi d’uso specifici, mentre CrawlR si distingue per il suo approccio orientato all’azione, la prioritizzazione automatica e l’integrazione con App Eskimoz, che collega il crawling all’intera strategia SEO, inclusi contenuti e dati.

Perché Eskimoz ha sviluppato CrawlR

Da oltre dieci anni, i team di Eskimoz supportano le aziende che si trovano ad affrontare la stessa difficoltà: gli audit tecnici forniscono migliaia di dati, ma poche azioni concrete.

Tra backlog tecnici, prioritizzazione delle attività e mancanza di chiarezza sull’impatto aziendale, i team SEO e marketing faticano a passare dall’osservazione alla scelta.

CrawlR nasce da questa realtà.

Lo strumento è stato progettato per colmare il divario tra dati e azione, ponendo la definizione delle priorità al centro dell’analisi tecnica. Ogni raccomandazione generata da una scansione viene ponderata in base al suo effettivo impatto SEO: indicizzazione, link interni, tag HTML, contenuti e prestazioni.

L’obiettivo: aiutare i decisori a proteggere i propri budget SEO dimostrando il contributo diretto di ogni ottimizzazione ai KPI aziendali.

Oltre allo strumento in sé, CrawlR fa parte della suite App Eskimoz: un ecosistema unico in cui crawling, contenuti e dati interagiscono. L’audit tecnico non è più fine a sé stesso, ma diventa un punto di partenza per un miglioramento continuo.

- Le anomalie rilevate in CrawlR possono essere trasmesse a Scribe per la rielaborazione dei contenuti.

- Le ottimizzazioni possono quindi essere monitorate tramite Monitoring e correlate alla visibilità dell’IA con LLM Ranking.

👉 In breve: CrawlR non è solo uno strumento di esplorazione, è un framework di gestione SEO orientato all’impatto, progettato da esperti che comprendono i vincoli sul campo dei team digitali.

I limiti di una scansione senza interpretazione umana

Nemmeno il miglior strumento di crawling SEO può sostituire l’analisi strategica di un esperto.

Un crawler può identificare anomalie, ma non può valutarne l’importanza per il business o determinare la vera priorità di un’azione in base agli obiettivi del sito.

È qui che entra in gioco l’esperienza umana.

I consulenti SEO di Eskimoz lo vedono ogni giorno: una semplice scansione può facilmente generare centinaia di raccomandazioni tecniche, alcune critiche, altre di minore importanza. Senza interpretazione, il rischio è di perdersi nel volume invece di concentrarsi sull’impatto.

Questo è esattamente ciò che CrawlR si propone di risolvere.

Lo strumento struttura i dati, li prioritizza in base a SEO e impatto aziendale e li presenta in modo leggibile e fruibile .

L’esperto, tuttavia, mantiene il ruolo decisivo: analizzare le cause, adattare la strategia e collegare le azioni ai KPI. Insieme, formano una combinazione vincente: i dati per la precisione, la competenza umana per la direzione.

👉 In pratica: un’analisi senza interpretazione è illuminante, ma un’analisi con la guida di un esperto genera risultati misurabili.

To do a partire da questa settimana:

- Esegui una scansione completa del tuo sito per identificare cosa ostacola l’indicizzazione.

- Valuta la priorità delle azioni SEO in base al loro potenziale impatto sul traffico e sulle conversioni.

- Prova CrawlR sull’applicazione Eskimoz per trasformare i tuoi audit tecnici in decisioni orientate al ROI.

Domande frequenti sugli strumenti di crawling:

Che cos’è uno strumento di crawl SEO?

Uno strumento di crawl SEO esplora un sito web nello stesso modo in cui lo farebbe Googlebot. Rileva errori tecnici (indicizzazione, tag, link, contenuti duplicati) che ne ostacolano la visibilità organica.

Come scegliere il giusto strumento di crawling SEO?

La scelta giusta dipende dalle dimensioni della tua azienda, dai tuoi obiettivi e dalle tue competenze in materia SEO. I freelance danno priorità alla velocità (Screaming Frog), mentre team più strutturati optano per CrawlR , che è orientato all’azione e alle prestazioni.

CrawlR è gratuito?

CrawlR fa parte della Eskimoz App Suite, disponibile a partire da 400 € al mese. Questo pacchetto include crawling, monitoraggio, copywriting SEO e analisi della visibilità basata sull’intelligenza artificiale in un ambiente integrato.

Qual è la differenza tra un crawler SEO e un analizzatore di log?

Il crawler analizza la struttura di un sito, mentre l’analizzatore di log osserva il comportamento effettivo dei bot. Combinati, forniscono una panoramica completa delle prestazioni di scansione e SEO.

È possibile eseguire il crawling di un sito web senza comprometterne le prestazioni?

Sì, a condizione che si limiti la velocità di scansione e che non la si esegua durante le ore di punta. CrawlR ottimizza la frequenza di scansione per evitare interruzioni della navigazione o di sovraccaricare il server.

Quale strumento dovrei scegliere per un sito con più di un milione di URL?

Soluzioni cloud come CrawlR, OnCrawl e Botify sono in grado di gestire volumi elevati. CrawlR si distingue per la visualizzazione dei dati e la prioritizzazione automatica, ideali per siti web complessi.