Per molto tempo, i team marketing hanno considerato l’intelligenza artificiale soprattutto come uno strumento di ottimizzazione: risparmiare tempo, automatizzare attività, produrre più velocemente. Utile, sì, ma raramente davvero strategico.

Questo paradigma oggi sta cambiando.

Con la diffusione dei modelli linguistici avanzati (LLM), l’IA non si limita più a rispondere ai prompt: ragiona, sintetizza, formula raccomandazioni e, soprattutto, interagisce con sistemi esterni. CRM, strumenti di analytics, database interni, piattaforme cloud: tutto può contribuire al ragionamento di un modello.

Questa promessa, però, aveva un limite importante: la mancanza di uno standard.

Come collegare in modo ordinato un modello a più fonti dati, senza ricostruire ogni volta un’integrazione complessa e difficile da mantenere?

È qui che entra in gioco il Model Context Protocol (MCP).

Ancora poco noto in ambito marketing, questo protocollo è in realtà una delle “basi” più rilevanti dell’IA moderna: determina la capacità dei modelli di produrre risposte utilizzabili, contestualizzate e allineate a obiettivi di business concreti — soprattutto in ambiti come global search, personalizzazione e gestione data-driven.

Definizione e principi del Model Context Protocol

Che cos’è il Model Context Protocol (MCP)

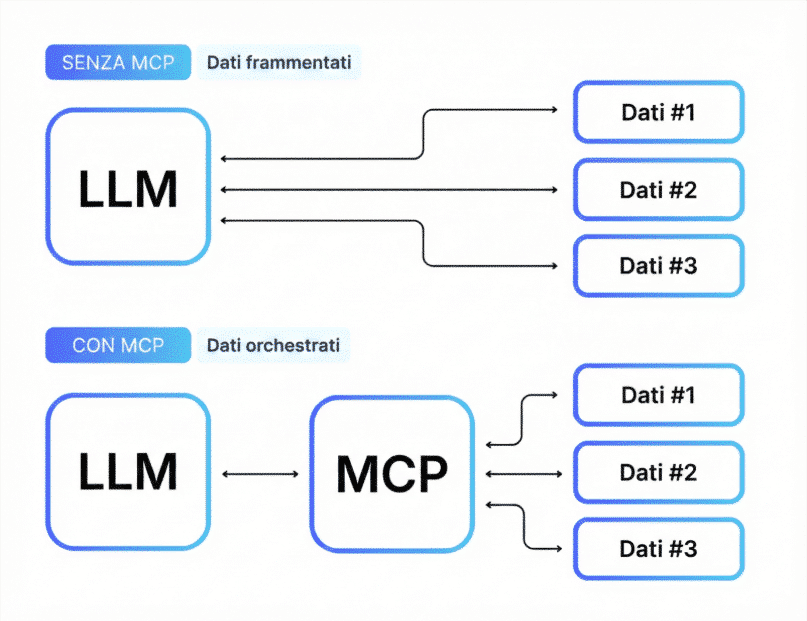

Il Model Context Protocol è un protocollo di comunicazione standardizzato che consente a un modello linguistico di accedere a informazioni esterne in modo strutturato e sicuro. In altre parole, permette a un LLM di non operare più “a sistema chiuso”.

Senza MCP, un modello risponde solo sulla base di:

- ciò che ha appreso durante l’addestramento,

- il testo fornito nel prompt.

Con MCP, invece, può arricchire il proprio ragionamento recuperando:

- dati di business,

- informazioni in tempo reale,

- strumenti o servizi esterni esposti da un server.

Questo passaggio è cruciale: l’IA non è più soltanto conversazionale, ma diventa un componente attivo di un sistema informativo.

Origine ed evoluzione del protocollo

Il MCP non nasce da una moda, ma da un’esigenza concreta. Man mano che i casi d’uso dell’IA sono diventati più complessi, le integrazioni “artigianali” hanno mostrato i propri limiti: connettori su misura, manutenzione pesante, dipendenza da implementazioni proprietarie.

Il Model Context Protocol va nella direzione opposta: interoperabilità, standardizzazione, apertura. Un po’ come HTTP ha rappresentato un linguaggio comune per il web, il MCP punta a diventare un linguaggio condiviso tra modelli e sistemi esterni.

La sua adozione è stata accelerata anche da ambienti come Claude Desktop o Cursor, che hanno mostrato come un server MCP ben progettato permetta di connettere rapidamente un LLM a fonti dati diverse, senza reinventare tutto a ogni progetto.

I principi fondamentali

Il MCP si fonda su un’idea semplice: separare chiaramente i ruoli. Il modello agisce come client; dati, strumenti e servizi sono esposti da un server MCP.

Questa separazione garantisce:

- un controllo più preciso degli accessi,

- maggiore sicurezza,

- una scalabilità nettamente superiore rispetto alle integrazioni ad hoc.

Soprattutto, il contesto non è più statico: diventa dinamico e si arricchisce “su richiesta”, in base all’intenzione, al caso d’uso e alle necessità operative.

Come funziona il MCP nelle architetture basate su modelli

Integrazione operativa del MCP

In un’architettura basata sul Model Context Protocol, il modello non prova più a “sapere tutto”: sa dove reperire l’informazione giusta.

Quando un utente pone una domanda o attiva un’azione:

- l’LLM interpreta l’intento,

- identifica i dati necessari,

- interroga uno o più server MCP,

- integra le informazioni nel proprio ragionamento.

Per i team marketing è un cambio significativo: l’IA non produce soltanto testo, ma lavora sullo stesso patrimonio informativo utilizzato dai team umani.

Integrazione nei sistemi di IA

Il MCP si inserisce naturalmente negli stack moderni: strumenti SaaS, ambienti cloud, piattaforme data. Consente di collegare un modello a un CRM, a dashboard analytics o a database interni senza esporre direttamente questi sistemi al modello.

Questo apre la strada a utilizzi più avanzati, ad esempio:

- raccomandazioni basate su dati cliente reali,

- analisi incrociate tra SEO, SEA e contenuti,

- gestione delle campagne supportata dall’IA.

Applicazioni in machine learning e NLP

Nel NLP, il Model Context Protocol aiuta a superare i limiti dei modelli generalisti: le risposte diventano più precise e pertinenti perché si basano su un contesto operativo reale, non su semplici inferenze statistiche.

È anche uno dei pilastri delle strategie di RAG (Retrieval-Augmented Generation), oggi centrali nelle applicazioni IA più efficaci.

Benefici e sfide del MCP nel marketing digitale

Perché l’MCP è una leva strategica

Il marketing digitale convive con una contraddizione costante: i dati sono abbondanti, ma trasformarli in insight davvero azionabili è sempre più difficile. Il Model Context Protocol risponde direttamente a questo problema, perché consente ai modelli linguistici di lavorare con gli stessi segnali utilizzati dai marketer — e non “a lato” di essi.

Personalizzazione: dal targeting al contesto

Con il MCP, un modello può integrare:

- storico cliente,

- comportamento di navigazione,

- contesto di ricerca,

- maturità nel funnel.

Si passa così dalla segmentazione statica a una personalizzazione contestuale in tempo reale. Il messaggio non è soltanto “adattato”: è coerente con la situazione specifica dell’utente.

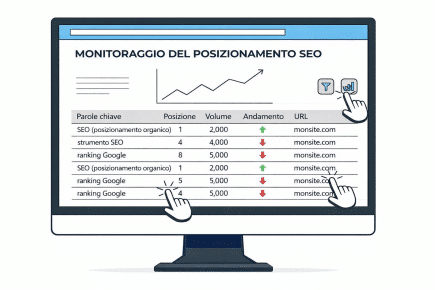

Global Search: perché diventa indispensabile

In un ecosistema in cui le intenzioni di ricerca si distribuiscono tra Google, motori IA, marketplace e social, la Global Search richiede una visione complessiva. Il MCP rende possibile collegare segnali provenienti da canali diversi per produrre una risposta unificata, coerente e performante.

Senza un protocollo di questo tipo, l’IA resta “cieca” rispetto alle dinamiche reali. Con esso, diventa una leva concreta per guidare visibilità e performance.

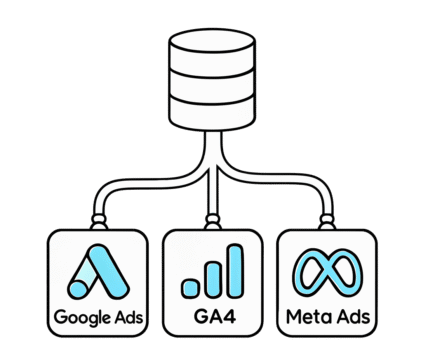

Esempi di MCP marketing e valore aggiunto per un LLM

| MCP | Ce que le LLM comprend grâce à ce MCP |

|---|---|

| MCP GA4 | Percorsi utenti, engagement reale, contributo di pagine e canali alla conversione. |

| MCP Google Ads | Costi, performance e intenzioni paid per supportare le scelte SEO/SEA. |

| MCP Google Search Console | Query, posizioni e pagine realmente visibili su Google, base della strategia Global Search |

| MCP Ahrefs | Autorità, backlink e gap competitivi SEO. |

| MCP SEMrush | Copertura semantica, trend keyword e pressione competitiva. |

| MCP Similarweb | Les dynamiques de marché, les sources de trafic et le Dinamiche di mercato, fonti di traffico e posizionamento relativo degli attori. |

| MCP App Eskimoz (in arrivo) | Vista unificata per guidare visibilità, acquisizione e decisioni Global Search, oltre a vari tool come punteggi di autorità, backilink e prompt monitoring. |

MCP e visibilità nei LLM: cosa bisogna capire davvero

Con la diffusione di ChatGPT, Gemini o Perplexity, in marketing torna spesso una domanda:

è possibile creare un Model Context Protocol per “dare accesso” alle proprie informazioni a questi motori e migliorare la visibilità nelle loro risposte?

Qui serve chiarezza, perché la risposta cambia l’impostazione strategica.

Il MCP non è un protocollo di posizionamento

Il Model Context Protocol non è un meccanismo per diffondere informazioni verso LLM pubblici. Un server MCP non viene esplorato, “crawled” o interrogato spontaneamente da ChatGPT o Gemini. Questi modelli non possono “scoprire” server MCP esterni, né integrarli automaticamente nelle risposte.

In pratica, oggi non esiste un “MCP pubblico” equivalente a un sito web o a un’API aperta che gli LLM utilizzino per arricchire le risposte.

Questa distinzione è centrale: il MCP è un protocollo di accesso controllato, non un canale di visibilità.

Come selezionano le fonti i LLM

Per generare risposte, i motori LLM si basano principalmente su:

- contenuti pubblici accessibili sul web,

- fonti editoriali riconosciute (media, enciclopedie, siti autorevoli),

- partner con dati in licenza,

- segnali di autorevolezza, coerenza e affidabilità.

In questo senso funzionano più come motori di ricerca semantici che come client MCP. La visibilità nei LLM dipende quindi soprattutto da logiche GEO (Generative Engine Optimization): struttura dei contenuti, credibilità delle fonti, frequenza delle citazioni, chiarezza con cui si risponde alle intenzioni.

Dove il MCP crea valore… indirettamente

Il legame interessante è qui: anche se non permette di “esporre” dati direttamente agli LLM pubblici, il MCP migliora la qualità della strategia a monte. Collegando un modello interno ai dati aziendali, consente di guidare in modo molto più accurato le decisioni editoriali e di visibilità.

In pratica, un server MCP può essere usato per:

- analizzare le risposte generate dagli LLM su un perimetro specifico,

- identificare fonti e formati più spesso citati,

- confrontare la visibilità del brand con quella dei competitor,

- individuare angoli editoriali che performano davvero sui motori IA.

Sono analisi difficili da eseguire manualmente e che, invece, permettono di orientare la strategia GEO con un livello di precisione superiore.

Dal MCP alla visibilità LLM: la catena del valore

Il rapporto tra MCP e visibilità nei LLM non è diretto, ma strutturale. Il MCP permette:

- una comprensione più profonda delle dinamiche di visibilità nei motori IA,

- decisioni più informate su cosa produrre,

- una prioritizzazione più fine di temi, formati e canali,

- maggiore coerenza tra SEO, contenuti e Global Search.

Migliorando la strategia a monte, il MCP aumenta indirettamente — ma in modo concreto — le probabilità di essere citati e valorizzati dagli LLM.

Da ricordare

Il Model Context Protocol non consente di “collegarsi” a ChatGPT o Gemini.

In compenso, permette ai team marketing di gestire la strategia GEO con un livello di controllo e lucidità superiore.

E in un contesto in cui la visibilità nei motori IA dipende sempre più da pertinenza, coerenza e autorevolezza, decidere meglio diventa un vantaggio competitivo reale.

FAQ sul Model Context Protocol (MCP)

Quali sono gli standard aperti attorno al Model Context Protocol?

Il MCP segue una logica open source, compatibile con gli standard API moderni e pensato per evolvere con gli ecosistemi cloud e IA.

Il Model Context Protocol è compatibile con tutti i modelli?

Sì, a condizione che il modello sia progettato per operare come client MCP. La maggior parte degli LLM moderni integra già questa logica.

Esistono alternative al Model Context Protocol?

Esistono implementazioni proprietarie, ma oggi nessuna offre lo stesso livello di standardizzazione, scalabilità e interoperabilità.